5.4 特征向量与线性变换

在本节,我们将矩阵分解A=PDP^{-1}理解为线性变换。我们还将看到变换x \mapsto Ax实质上是简单的映射u \mapsto Du。即使D不是对角矩阵时,对矩阵A和D仍有相似的解释。

在1.9节曾讲到,任意一个从R^n到R^m的线性变换T可通过左乘矩阵A来实现,矩阵A成为T的标准矩阵。现在,我们对连个有限维向量空间之间的线性变换也做同样的描述。

线性变换的矩阵

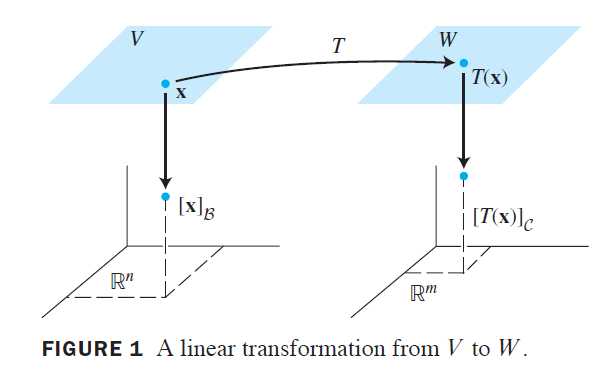

设V是n维向量空间,W是m维向量空间,T是V到W的线性变换,为了把T与矩阵相联系,我们指定\beta和C分别是V和W的基。

若x \in V,坐标向量\begin{bmatrix} x \end{bmatrix}_\beta \in R^n,x的像T(x)的坐标向量\begin{bmatrix} T(x) \end{bmatrix}_C \in R^m,见下图,

容易找出\begin{bmatrix}x\end{bmatrix}_\beta和\begin{bmatrix}T(x)\end{bmatrix}_C之间的关系。设V的基\beta是\{b_1,\dots,b_n\}。若x=r_1b_1+\dots+r_nb_n,则

因为T是线性的,故

因为从W到R^m的坐标映射是线性的(4.4节定理8),等式(1)可推出

因为这些C-坐标向量都属于R^m,向量等式(2)可以写为矩阵等式

其中

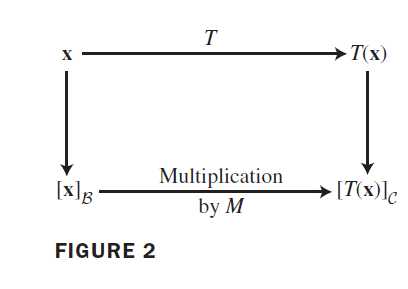

矩阵M是T的矩阵表示,称为T相对于基\beta和C的矩阵,见下图

等式(3)表明,就坐标向量而言,T对x的作用相当于用矩阵M左乘x

V到V的线性变换

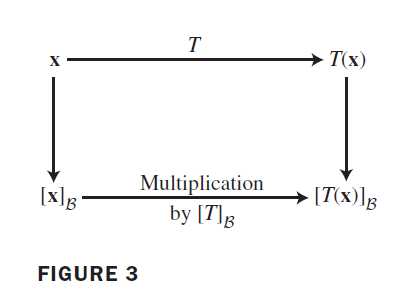

当W=V,C=\beta时,(4)中的M称为T相对于\beta的矩阵,或简称为T的\beta-矩阵,记为\left[T\right]_\beta,见下图:

V \rightarrow V的线性变换T的\beta-矩阵对所有V中的x,有

$R^n$上的线性变换

在涉及R^n的应用问题中,线性变换首先表现为一个矩阵变换x \mapsto Ax。假设A是可对角化的,那么存在由A的特征向量组成的R^n的基。此时,下面的定理8表明T的\beta-矩阵是对角矩阵,这样,把A对角化相当于找到变换x \mapsto Ax的对角矩阵表示。

定理8(对角矩阵表示)

设A=PDP^{-1},其中D为nxn对角矩阵,若R^n的基\beta由P的列向量组成,那么D是变换x \mapsto Ax的\beta-矩阵

矩阵表示的相似性

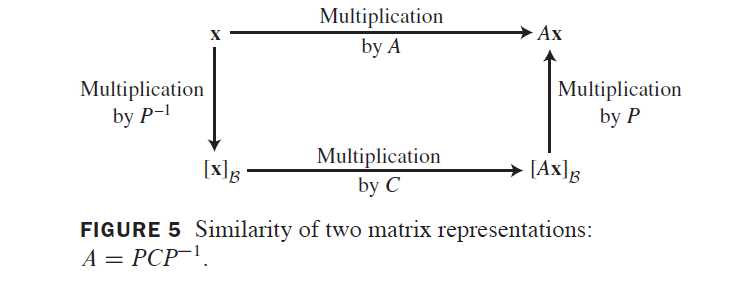

定理8的证明没有用到D是对角矩阵这一事实。因此,若A相似于C,即由A=PCP^{-1},如果\beta由P的列向量组成,则C是变换x \mapsto Ax的\beta-矩阵。分解A=PCP^{-1}如下图所示:

相反,若R^n \rightarrow R^n的变换T:T(x)=Ax,而\beta是R^n的任意一个基,那么T的\beta-矩阵相似于A